W dzisiejszym cyfrowym świecie, gdzie dane są nową walutą, a infrastruktura krytyczna opiera się na kodzie, cyberbezpieczeństwo stało się absolutnym priorytetem. Jednak krajobraz zagrożeń ewoluuje w bezprecedensowym tempie, a tradycyjne metody obrony przestają wystarczać. Wkraczamy w nową erę – erę, w której sztuczna inteligencja (AI) staje się zarówno najpotężniejszą bronią atakujących, jak i najbardziej wyrafinowaną tarczą obrońców. To początek prawdziwego wyścigu zbrojeń w cyberprzestrzeni.

Rewolucja AI: Nowe Możliwości, Nowe Zagrożenia

Sztuczna inteligencja, a w szczególności uczenie maszynowe (Machine Learning - ML), oferuje niesamowite możliwości analizy ogromnych zbiorów danych, wykrywania wzorców i automatyzacji zadań. W rękach cyberprzestępców te same technologie stają się narzędziami do tworzenia bardziej skutecznych, szybszych i trudniejszych do wykrycia ataków.

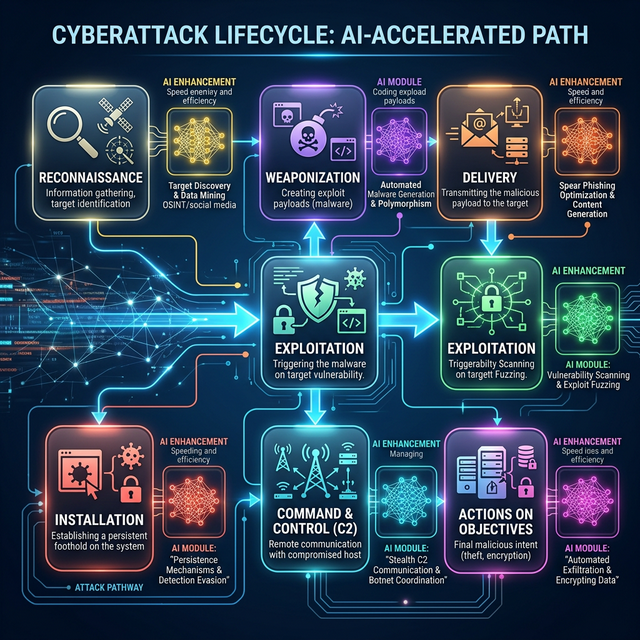

Tradycyjne ataki często opierały się na ręcznym wyszukiwaniu podatności lub masowym wysyłaniu prostych wiadomości phishingowych. AI zmienia reguły gry. Atakujący mogą teraz używać ML do:

- Automatycznego skanowania i identyfikacji podatności: Algorytmy mogą błyskawicznie analizować kod i konfiguracje systemów w poszukiwaniu luk, znacznie szybciej niż jakikolwiek człowiek.

- Tworzenia wysoce spersonalizowanych ataków phishingowych (spear phishing): AI może analizować publicznie dostępne dane o celu (np. z mediów społecznościowych), aby generować niezwykle przekonujące i spersonalizowane wiadomości, drastycznie zwiększając wskaźnik powodzenia.

- Optymalizacji złośliwego oprogramowania: AI może pomóc w tworzeniu polimorficznego malware'u, który automatycznie zmienia swój kod, aby uniknąć wykrycia przez tradycyjne programy antywirusowe oparte na sygnaturach.

- Automatyzacji łamania haseł: Wykorzystanie AI do przewidywania haseł na podstawie wzorców zachowań użytkowników i wycieków danych.

Poniższy diagram ilustruje, jak AI automatyzuje i przyspiesza poszczególne fazy cyberataku:

Tarcza napędzana przez AI: Inteligentna Obrona

Na szczęście, specjaliści ds. cyberbezpieczeństwa nie pozostają bierni. AI jest również fundamentem nowoczesnych systemów obronnych, oferując możliwości, o których wcześniej mogliśmy tylko marzyć.

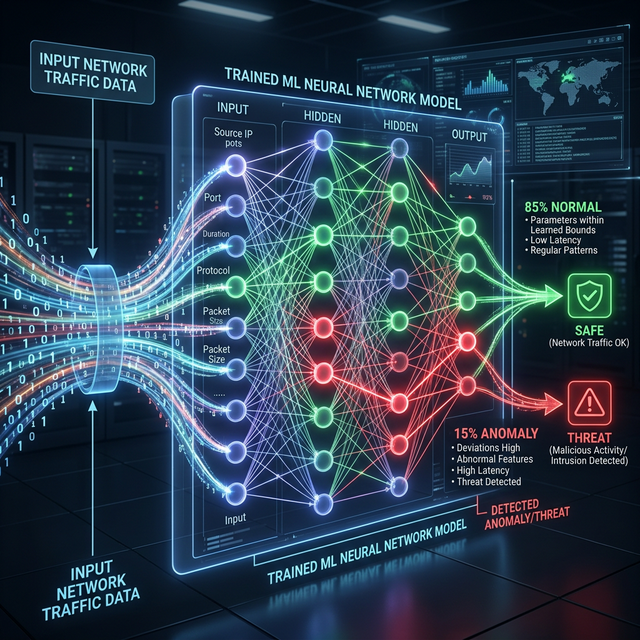

Kluczową zaletą AI w obronie jest jej zdolność do pracy w czasie rzeczywistym i analizy ruchu sieciowego na skalę niemożliwą dla człowieka. Systemy obronne oparte na AI wykorzystują ML do:

- Wykrywania anomalii: AI uczy się "normalnego" zachowania sieci i użytkowników. Każde odchylenie od tej normy – np. nietypowy transfer danych, logowanie z nowej lokalizacji o dziwnej porze – jest natychmiast flagowane jako potencjalne zagrożenie. To pozwala na wykrywanie ataków "zero-day", na które nie ma jeszcze gotowych sygnatur.

- Automatycznej odpowiedzi na incydenty: Systemy napędzane przez AI mogą automatycznie izolować zainfekowane urządzenia, blokować podejrzane adresy IP lub resetować uprawnienia użytkowników, co znacznie skraca czas reakcji i ogranicza szkody.

- Analizy zagrożeń (Threat Intelligence): AI potrafi przetwarzać ogromne ilości danych z różnych źródeł (logi, raporty, fora) w celu identyfikacji nowych trendów w atakach i proaktywnego wzmacniania obrony.

- Wykrywania złośliwego oprogramowania: Zaawansowane algorytmy analizują zachowanie plików i kodu, a nie tylko ich strukturę, co pozwala na wykrycie nawet nieznanego wcześniej malware'u.

Diagram poniżej pokazuje, jak działa system wykrywania anomalii oparty na uczeniu maszynowym:

Dynamika Wyścigu Zbrojeń

To, co czyni tę sytuację wyścigiem zbrojeń, to ciągła interakcja i adaptacja obu stron. Gdy obrońcy wdrażają nowe systemy oparte na AI, atakujący analizują ich działanie i szukają sposobów na ich obejście – często również przy użyciu AI. To dynamiczna pętla sprzężenia zwrotnego.

Przykładowo:

- Obrońcy wdrażają system ML do wykrywania spamu.

- Atakujący używają własnego modelu AI do generowania milionów wariantów wiadomości spamowych i testowania ich na systemie obronnym, aby znaleźć te, które przechodzą przez filtry.

- Obrońcy zbierają te nowe próbki i douczają swój model, czyniąc go bardziej odpornym.

- Atakujący szukają nowych podatności w samym modelu ML obrońców (tzw. adversarial machine learning)... i wyścig trwa dalej.

Poniższy diagram ilustruje tę ciągłą pętlę adaptacji:

Wyzwania i Etyka w Erze AI

Wykorzystanie AI w cyberbezpieczeństwie niesie ze sobą również szereg wyzwań i dylematów etycznych.

- Fałszywe Alarmy (False Positives): Nadmiernie czułe systemy AI mogą generować dużą liczbę fałszywych alarmów, co może prowadzić do zmęczenia alertami u analityków i ignorowania prawdziwych zagrożeń.

- Uprzedzenia w Modelach: Jeśli modele AI są trenowane na niepełnych lub stronniczych danych, mogą przejmować te uprzedzenia, co może prowadzić do niesprawiedliwego traktowania niektórych grup użytkowników lub systemów.

- Autonomiczna Broń Cybernetyczna: Istnieje ryzyko stworzenia systemów AI zdolnych do autonomicznego przeprowadzania cyberataków, co rodzi pytania o odpowiedzialność i kontrolę nad takimi narzędziami.

- Dostęp do Technologii: Wyścig zbrojeń faworyzuje podmioty z największymi zasobami, co może pogłębić dysproporcje w poziomie bezpieczeństwa między dużymi korporacjami a mniejszymi firmami.

Podsumowanie: Przyszłość jest Inteligentna

Wyścig zbrojeń w cyberprzestrzeni będzie się zaostrzał, a kluczem do sukcesu nie będzie tylko posiadanie najlepszej technologii, ale także umiejętność jej integracji z procesami biznesowymi, ciągłe uczenie się i współpraca między organizacjami.

Przyszłość cyberbezpieczeństwa to symbioza ludzkiej inteligencji i sztucznej inteligencji, gdzie AI automatyzuje rutynowe zadania i wykrywa złożone wzorce, a ludzie podejmują strategiczne decyzje i zajmują się najbardziej skomplikowanymi incydentami. Jedno jest pewne: w tym wyścigu nie ma linii mety.